MICCAI (Medical Image Computing and Computer Assisted Intervention Society) 是医学图像分析领域国际公认最具影响力的学术组织,代表了医学影像人工智能研究的风向标。今年10月,MICCAI 2023 会议将在加拿大温哥华举行。

近日,MICCAI 2023论文接收结果公布,上科大生医工学院累计25篇论文入选,沈定刚 (Dinggang Shen) 教授团队、王乾 (Qian Wang) 教授团队、崔智铭 (Zhiming Cui) 教授团队等斩获佳绩。这一成绩表明,上科大生医工学院在短短两年多时间内,研究成果已被国际认可,学生培养初见成效。

>>> MICCAI 2023 中稿成果示例(部分)

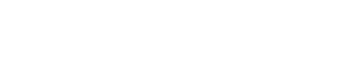

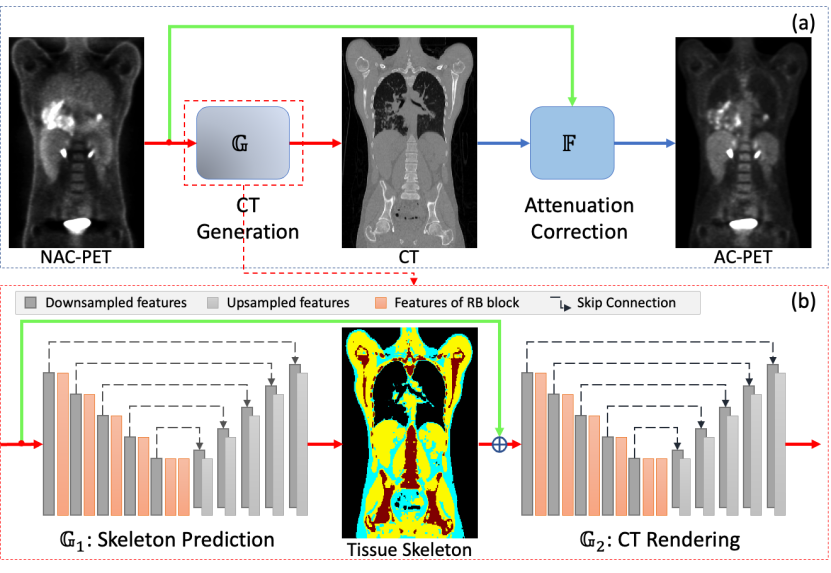

◆Revealing Anatomical Structures in PET to Generate CT for Attenuation Correction, MICCAI 2023, Vancouver, Canada, October 8-12, 2023. [Yongsheng Pan, Feihong Liu, Caiwen Jiang, Jiawei Huang, Yong Xia, Dinggang Shen]

正电子发射断层扫描 (PET) 是一种分子成像技术,它依赖于预先确定的衰减系数来校正放射性核素的分布。传统的衰减校正技术需要额外获得计算机断层扫描 (CT) 或磁共振 (MR) 图像来计算衰减系数,这既增加了成像时间和费用,又增加了对患者的辐射危害,特别是对于全身扫描,这些弊病变得更加严重。本文考虑到,随着 PET 信号采集技术的进步,原始的 PET 图像中将可能包含更多的解剖信息,因此提出了利用 PET 自身进行衰减校正。为了实现这一目标,我们设计了一个基于深度学习的框架,即解剖结构增强生成 (ASEG),从非衰减校正的 PET 图像中生成伪 CT 图像,并利用伪 CT 进行衰减校正。具体来说,ASEG 包含两个顺序模块,即解剖组织预测模块和细节绘制模块。前一个模块首先绘制解剖结构图,后一个模块绘制组织细节。这两个模块都基于特定的解剖一致性约束进行训练,以保证组织生成的保真度。在4个公开的 PET/CT 数据集上的实验表明,本文的 ASEG 在生成的 CT 图像中获得了更好的解剖结构一致性,明显优于现有的方法。在 PET 衰减校正的进一步应用,也能够使校正的 PET 影像与真实的影像具有更好的相似性。这项工作验证了在不获取额外图像的情况下,从原始 PET 生成用于衰减校正的伪 CT 的可行性。

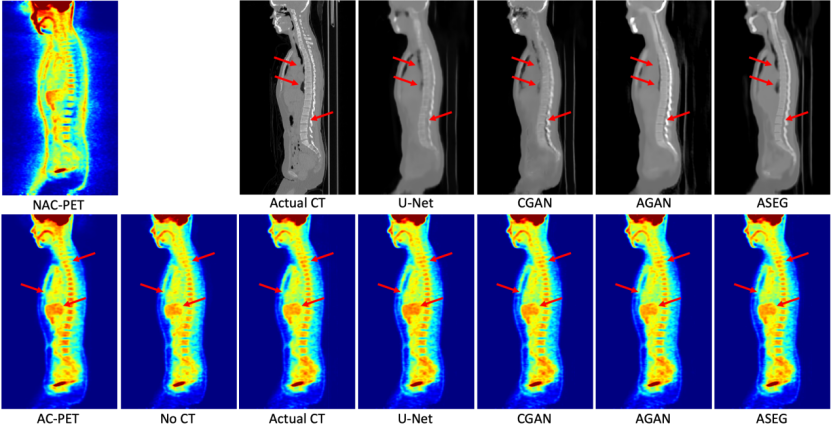

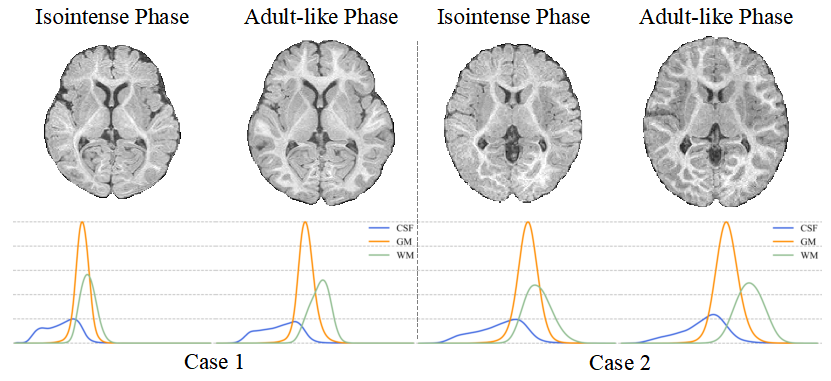

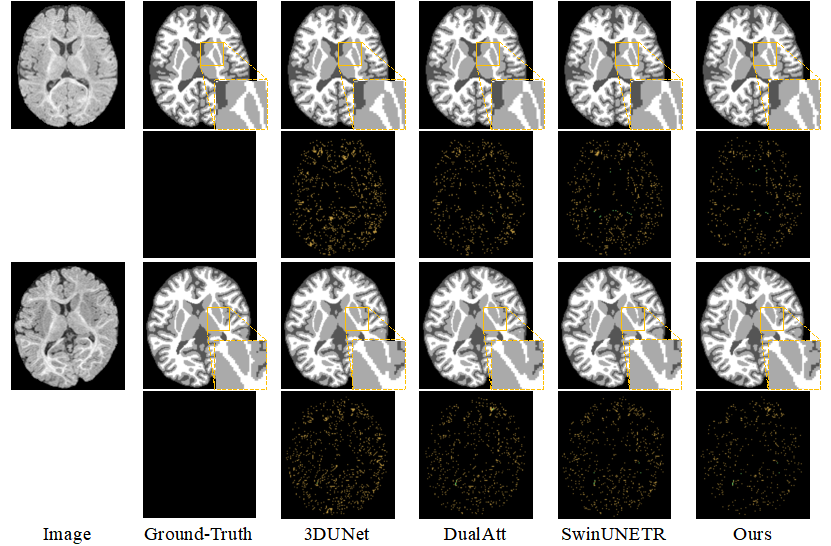

◆Adult-like Phase and Multi-scale Assistance for Isointense Infant Brain Tissue Segmentation, MICCAI 2023, Vancouver, Canada, October 8-12, 2023. [Jiameng Liu, Feihong Liu, Kaicong Sun, Mianxin Liu, Yuhang Sun, Yuyan Ge, Dinggang Shen]

精确且自动的脑组织分割对于婴儿发育跟踪和早期脑部疾病诊断至关重要。然而,由于新生儿出生后的第一年中存在的髓鞘化和成熟过程,大约在6个月左右 (等密度阶段),MRI 数据中灰质和白质之间的强度对比极低。这使得对等密度阶段脑组织的自动分割变得困难,即使是手动标注也是如此。针对这一问题,我们提出了一种利用成人相似期数据 (12个月左右) 的结构先验和更大感受野的脑组织来辅助等密度阶段数据的脑组织分割的方法。具体而言,我们利用大量已经标注的成人相似期脑组织数据生成等密度阶段的脑组织数据,以解决等密度阶段标注数据少的问题。同时,将生成的等密度期数据与成人相似期数据进行配对,作为结构先验,以增强等密度期模糊的组织边界。我们的实验结果表明,相较于现有方法,我们提出的方法在定量和定性方面都取得了显著的改进。这一方法有助于更加准确地测量脑发育并实现更早期的脑部疾病诊断。

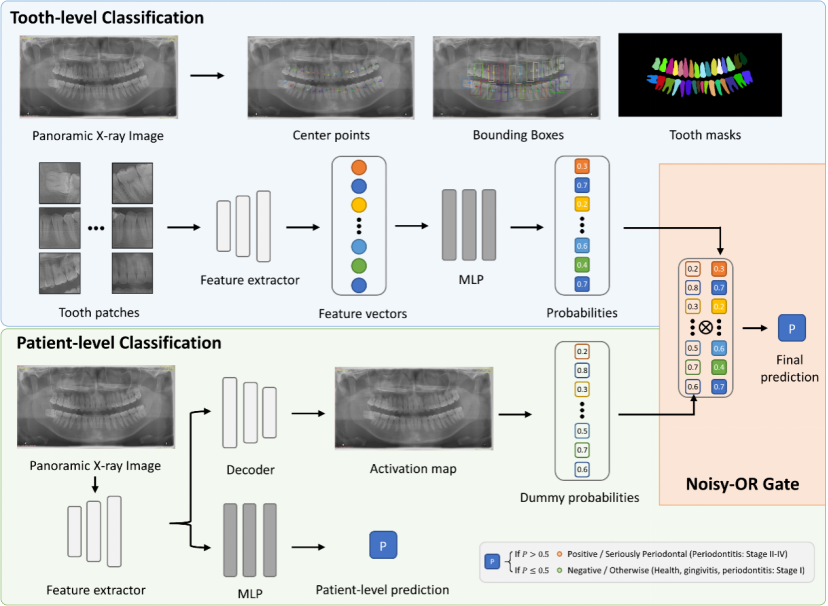

◆HC-Net: Hybrid Classification Network for Automatic Periodontal Disease Diagnosis, MICCAI 2023, Vancouver, Canada, October 8-12, 2023 [Lanzhuju Mei, Yu Fang, Zhiming Cui, Ke Deng, Nizhuan Wang, Xuming He, Yiqiang Zhan, Xiang Zhou, Maurizio Tonetti, Dinggang Shen]

从全景 X 线图像准确分类牙周疾病对于高效的临床诊断和治疗非常重要。由于放射影像分类牙周疾病需要细致的测量和综合的评估,这一直是一项具有挑战性的任务。最近的方法利用在放射图像上的手工标注来进行分割或者关键点检测,从而估计放射图像上的骨质丧失来分类牙周疾病。然而,由于这些放射图像上的标注与临床探针测量不一致,可能导致测量误差和不稳定的分类。在本文中,我们提出了一个新颖的混合分类框架 HC-Net,利用临床探针测量来分类放射图像中的牙周疾病,它由三个组件组成,即牙齿层面分类、患者层面分类和可学习的自适应噪声门控组件。具体而言,在牙齿层面分类中,我们首先引入实例分割网络来捕捉每颗牙齿,然后对每颗牙齿的牙周疾病进行分类。对于患者层面分类,我们利用多任务策略来共同学习患者层面的分类和反映放射图像上局部病变区域置信度的分类激活图 (CAM)。最终,自适应噪声门控组件通过整合两个级别的预测获得混合分类结果。对从实际临床收集的数据集进行大量实验证明,我们提出的 HC-Net 在牙周疾病分类方面实现了最先进的性能,并显示出巨大的应用潜力。

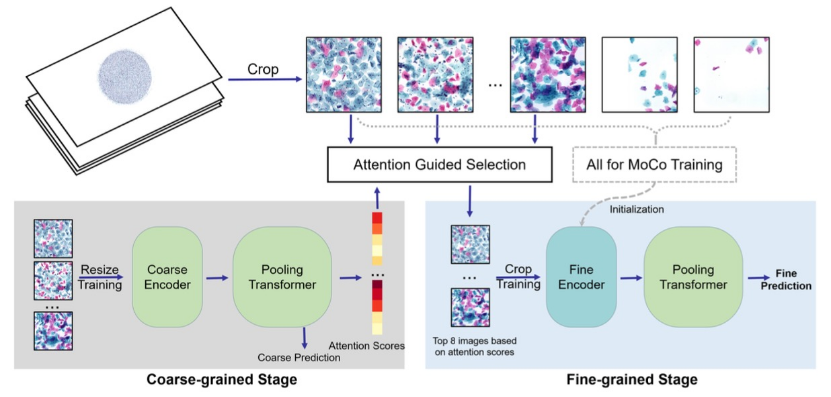

◆Detection-free Pipeline for Cervical Cancer Screening of Whole Slide Images, MICCAI 2023, Vancouver, Canada, October 8-12, 2023. [Maosong Cao, Manman Fei, Jiangdong Cai, Luyan Liu, Lichi Zhang, Qian Wang]

宫颈癌在全球范围内是一个重要的健康负担,计算机辅助诊断 (CAD) 流程有可能提高诊断效率和治疗效果。然而,传统的 CAD 流程由于需要在大量注释数据集上训练检测模型,存在局限性,这可能会导致成本和时间的浪费,它们还具有明显的性能上限和低数据利用率。为了解决这些问题,我们提出了一种双阶段无检测流程,该流程最大程度地利用了全切片图像 (WSI) 的数据,仅使用样本级诊断标签进行训练。实验结果证明了我们方法的有效性,且随着数据量的增加,性能不断提高。总的来说,我们的新型流程有潜力充分利用 WSI 分类中的海量数据,从而显著提高癌症诊断和治疗效果。通过减少对昂贵数据标注和检测模型的依赖,我们的方法有可能使 CAD 流程在临床环境中得到更广泛和更具成本效益的使用。

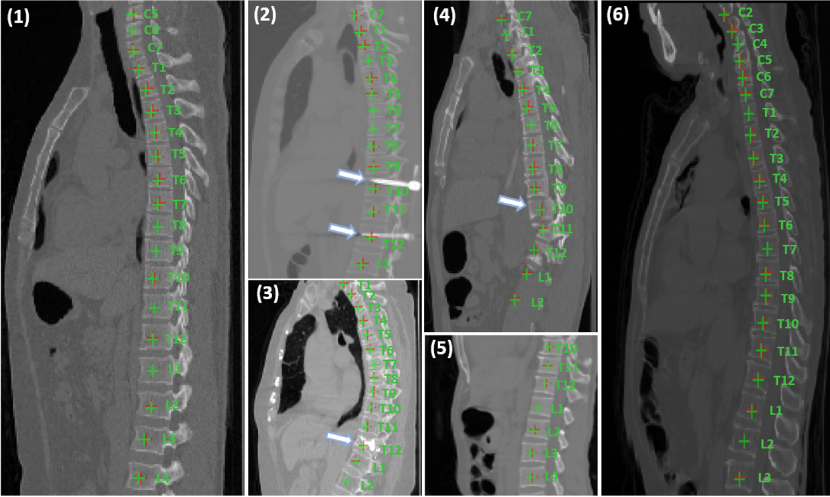

◆Multi-View Vertebra Localization and Identification from CT Images, MICCAI 2023, Vancouver, Canada, October 8-12, 2023. [Han Wu, Jiadong Zhang, Yu Fang, Zhentao Liu, Nizhuan Wang, Zhiming Cui, Dingggang Shen]

从 CT 图像中准确定位和识别椎骨对于各种临床应用至关重要。然而,大多数现有的工作都是在 3D 上进行裁剪 patch 操作,这类方法计算成本高昂并且捕捉的全局信息有限。在本文中,我们提出了一种从 CT 图像中进行多视角脊椎定位和识别的方法,将 3D 问题转化为不同视角上的 2D 定位和识别任务。我们的方法在不受三维 patch 限制的情况下可以自然地学习多视角的全局信息。此外,我们提出了一种多视角对比学习策略来预训练网络更好捕捉多视角下不变的解剖结构特征。为了更好捕捉序列信息,我们还引入了序列损失作为额外监督来维持预测椎骨中的序列结构。评估结果表明,仅通过两个 2D 网络,我们的方法可以准确地定位和识别 CT 图像中的椎骨,并且始终优于最先进的方法。

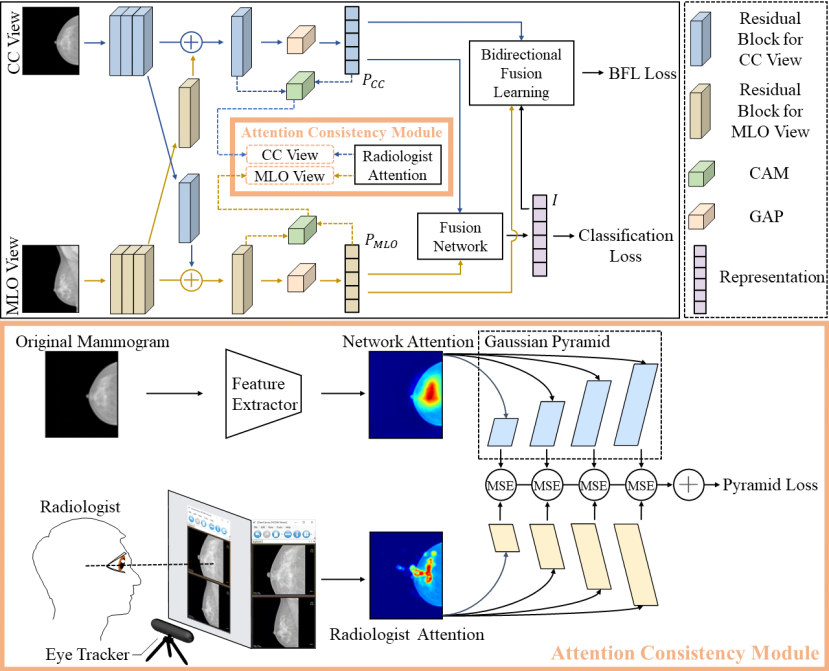

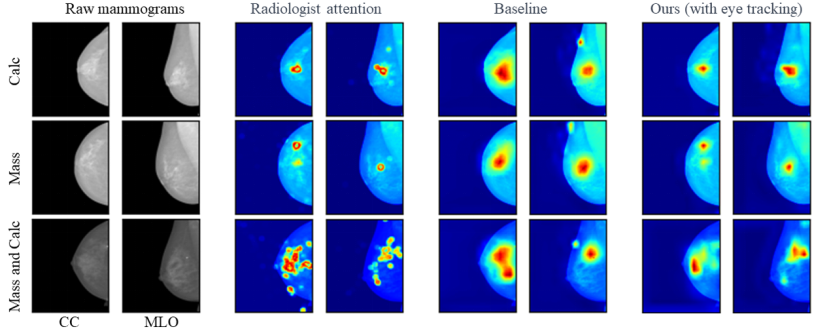

◆Mammo-Net: Integrating Gaze Supervision and Interactive Information in Multi-view Mammogram Classification, MICCAI 2023, Vancouver, Canada, October 8-12, 2023. [Changkai Ji, Changde Du, Qing Zhang, Sheng Wang, Chong Ma, Jiaming Xie, Yan Zhou, Huiguang He, Dinggang Shen]

乳腺癌诊断是一项具有挑战性的任务,近年来,将深度学习技术应用于乳腺癌诊断成为一种流行趋势。然而,深度神经网络的有效性通常受到可解释性不足和需要大量手动注释的限制。为了解决这些问题,我们提出了一种新的方法:利用放射科医师的眼动信息和多视图数据进行乳腺钼靶分类。放射科医师的眼动信息是一种低成本、便捷的粗粒度标注形式,可以提供病变的粗略定位。我们还开发了一个金字塔损失函数,更好地适应眼动监督的过程。此外,考虑到许多研究忽视了与诊断有关的交互信息,我们在网络中采用基于 Transformer 的注意力机制交互多视图病理学信息,并采用双向融合学习更有效地融合多视图信息。实验结果表明,通过结合眼动数据和跨视图交互信息,我们提出的模型显著提高了乳腺钼靶分类性能和可解释性。

上科大生医工学院相关团队将继续深耕医学影像人工智能研究,注重产学研医结合,致力于具有国际影响力的原创成果产出和临床转化应用,持续推动学院在国际上的影响力。